Indice dell'articolo

Il 16 ottobre 2024, ho avuto l’onore di partecipare come relatore al quinto convegno “Sex and the Cancer” di MamaNonMama APS, un’occasione per esplorare il tema dell’intelligenza artificiale (IA) in sanità, affrontando non solo le potenzialità di questa tecnologia ma anche le importanti responsabilità che ci aspettano [1]le slide presentate al Convegno sono presenti su Canva.

Credo fermamente che l’IA possa rappresentare una svolta positiva nel settore sanitario, a patto che la si sviluppi e adotti seguendo una chiara direzione etica.

Dalla fantascienza alla realtà

Quando parliamo di IA, non posso non pensare a quanto fosse, fino a pochi anni fa, una tecnologia che immaginavamo relegata alla fantascienza. Oggi, abbiamo robot assistenti e sistemi di diagnostica avanzata che supportano concretamente il lavoro di medici e operatori sanitari. Tuttavia, non basta parlare di innovazione: serve, soprattutto in questo ambito, costruire un percorso etico che garantisca l’integrità del rapporto medico-paziente e che tuteli il rispetto dei diritti fondamentali di ciascuno di noi.

Come nascono i principi etici per l’IA in Sanità?

Sono convinto che un approccio responsabile all’IA debba partire da linee guida chiare. Con la Rome Call del 2020 le istituzioni, tra cui la Pontificia Accademia per la Vita, IBM, Microsoft, FAO e il MID, hanno fissato i primi principi che, nella loro evoluzione, hanno posto le basi dell’EU AI Act, la regolamentazione europea all’avanguardia per un’IA responsabile [2] IBM & Microsoft are building these standards into the products (Ieee.org) [3] Intel also has developed platforms and solutions to make responsible AI computationally tractable (Intel.com) . Questa normativa rappresenta il primo consolidamento concreto delle regole chiare per l’IA a livello europeo, garantendo sicurezza, trasparenza e tutela della privacy in ogni sua applicazione.

La supervisione umana e la sicurezza tecnica

Il principio più importante è quello della supervisione umana. Nel mondo dell’IA agente, dove abbiamo autovetture autonome senza volante né pedali, è lampante il bisogno di avere un “red button”, un disinnesco, con particolare attenzione alla forma da attribuirgli, sia essa fisica e/o digitale.

Non meno importante è il principio della sicurezza tecnica. Credo che sia essenziale proteggere i pazienti da ogni possibile rischio derivante da malfunzionamenti o vulnerabilità dei sistemi IA. La sicurezza passa attraverso una progettazione rigorosa e il rispetto di protocolli di cybersecurity, oltre che da una supervisione costante. Se l’IA resta uno strumento nelle mani degli operatori, discorso più raffinato è quello relativo alla gradazione del potere di decisione che ingloba e supera nella sostanza il laconico interesse alla sostituzione del giudizio umano, così distinguiamo l’autonomia dall’indipendenza. Questo principio, che è uno dei pilastri dell’EU AI Act [4] EU AI ACT, Regulation EU n.2024/1689 (Eur-lex.europa.eu) , ci aiuta a mantenere il controllo necessario per rendere l’IA un vero alleato della medicina.

Rispetto della privacy e responsabilità nel trattamento dei dati

Altre questioni sensibili sono il rispetto della privacy e la gestione etica dei dati clinici. In un contesto in cui l’IA necessita di grandi quantità di dati per funzionare al meglio, è essenziale che ogni informazione raccolta sia trattata con la massima cautela. Nell’epoca del Fascicolo Sanitario Elettronico, dell’interoperbilità e degli standard atti a fugare il pericolo di lock-in, diventa cruciale tutelare il paziente, gestendo minuziosamente i dati a cui l’IA può accedere. Non è solo una necessità legale, ma una questione di fiducia che ogni paziente ripone nel sistema sanitario.

Trasparenza

Ogni decisione presa dall’IA deve essere tracciabile e documentata, così che sia chiara e verificabile non solo dagli specialisti, ma anche dai pazienti e dalle autorità. Ciò significa che dell’IA deve potersi spiegare il processo e la decisione, eliminando ogni black box. Puntiamo, quindi, alla spiegabilità (explainability, XAI) e all’intelligibilità, così che ogni passaggio sia documentabile con schede tecniche (factsheet) e cautele (safeguard), così da rendere ogni decisione più sicura e comprensibile.

Inclusività ed equità

Il coinvolgimento di più parti (stakeholders, istituzioni, aziende, medici, pazienti, associazioni) consente di raggiungere un uso inclusivo di queste tecnologie, depurato da forme di discriminazione, atto a garantire pari opportunità e accesso alle cure per ogni individuo. L’IA diventa inclusiva attraverso una costante attenzione alla qualità dei dati che utilizziamo per addestrarla.

La IA Generativa, Sesso e Cancro

Al convegno, ho avuto modo di condividere i risultati di uno studio innovativo sull’uso della generative IA per facilitare il dialogo tra pazienti oncologici e medici, in particolare su temi delicati come la sessualità, appunto sesso e cancro [5] Generative artificial intelligence and non-pharmacological bias: an experimental study on cancer patient sexual health communications (ncbi.nlm.nih.gov) . Lo studio esamina gli esiti di un prompt specifico rivolto a chatGPT, in due versioni, la 3.5 e una addestrata con dati clinici. Il fine è comprendere come l’IA risponde e come influisce nell’aiutare i pazienti a esprimere le loro difficoltà in questo ambito, spesso trascurato ma cruciale per la qualità della loro vita. Il risultato dello studio evidenzia che l’IA facilita la comunicazione con l’utente (che non è un paziente), permettendo anche di rispondere a quesiti complessi senza censura terminologica ma presenta un bias cruciale non menzionando la via farmacologica, come possibilità di trattamento, invitando sostanzialmente al consulto medico.

Accountability

Ogni azione compiuta dall’IA deve essere chiaramente attribuibile a una organizzazione e/o persona, in modo da evitare incertezze o conflitti di responsabilità che potrebbero compromettere la fiducia dei pazienti e la sicurezza delle cure. La responsabilità si applica a più livelli, coinvolgendo medici, operatori sanitari, amministratori, fino ai produttori dei sistemi IA e ai responsabili tecnici.

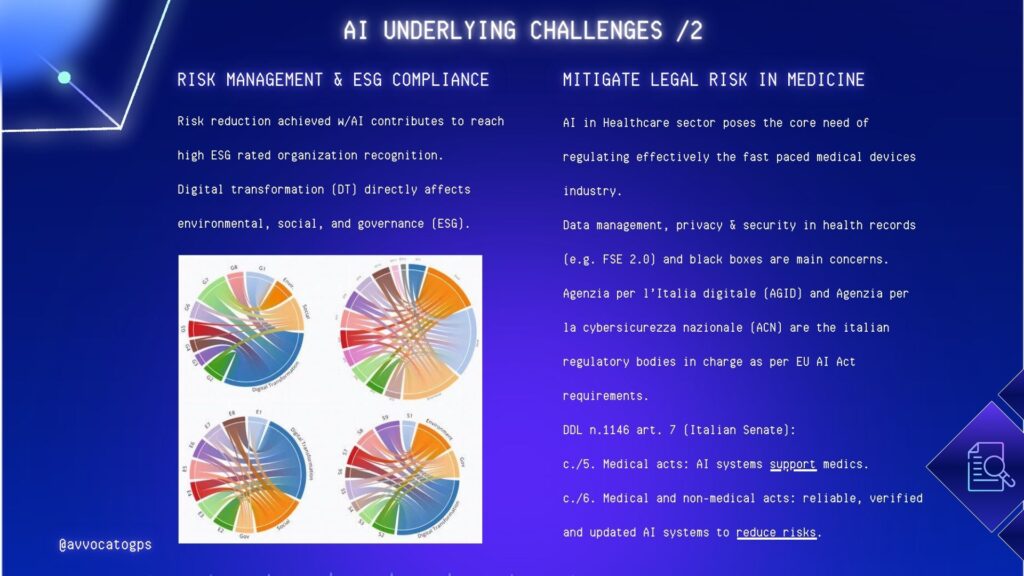

Secondo il D.D.L. n.114 in seno al Senato, l’IA funge da supporto all’atto medico mentre nell’atto non medico svolge funzioni in autonomia con supervisione umana atta a ridurre i rischi.

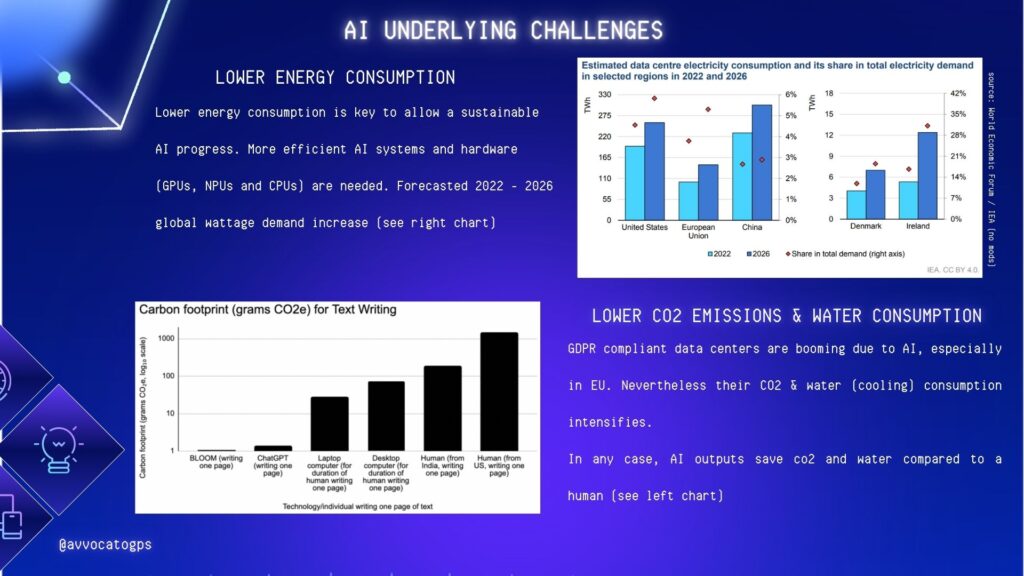

Sostenibilità: affrontare le sfide energetiche

Ritengo essenziale affrontare le sfide energetiche legate all’IA. Con l’aumento della domanda, l’importanza della sostenibilità energetica diventa nodale e grande attenzione va rivolta all’efficientamento sia lato software delle IA stesse, sia al lato hardware, tramite Data Center muniti di migliori unità (GPU, NPU e CPU), per ridurre le emissioni di CO2 e il consumo di acqua. La sostenibilità deve essere parte integrante del nostro impegno verso l’IA [6] AI and energy: Will AI help reduce emissions or increase demand? Here’s what to know (Weforum.org) [7] The carbon emissions of writing and illustrating are lower for AI than for humans (Nature.com) . L’azione di una politica aziendale di efficientamento enrgetico influisce sul raggiungimento di elevati standard ESG in quanto sostenuti dalla Digital Transition al crescere dell’apporto IA [8] A Sustainable Model for Healthcare Systems: The Innovative Approach of ESG and Digital Transformation (Mdpi.com, Anastasios Sepetis) .

Consapevolezza dei rischi: le allucinazioni e altri limiti dell’IA

Non possiamo, però, ignorare i limiti dell’IA. Dobbiamo restare particolarmente attenti ai cosiddetti rischi di allucinazioni (non cliniche), risposte errate e potenzialmente dannose che l’IA può generare. Questa consapevolezza guida nell’assicurare che ogni sistema IA sia monitorato e costantemente aggiornato, per evitare che errori o pregiudizi nei dati possano avere ripercussioni negative sui pazienti [9] The Importance of AI Governance (IBM on youtube.com) [10] Why AI ethics? (IBM on youtube.com) [11] What are AI agents? (IBM on youtube.com) .

I Vantaggi di una IA etica

Nonostante i rischi, un’IA progettata e utilizzata in modo etico può portare vantaggi straordinari alla sanità. Un esempio è l’uso dell’IA nella diagnostica, nella prevenzione e nella gestione delle emergenze, settori in cui le tecnologie possono aumentare l’efficienza e ridurre i tempi di attesa, migliorando l’esperienza dei pazienti e ottimizzando le risorse sanitarie. Ancor più straordinario il sistema di folding proteico di Google col recente riconoscimento del Nobel per la chimica ai 3 scienziati che lo hanno realizzato [12] AlphaFold Protein Structure Database (Alphafold) .

Conclusioni: un futuro promettente con l’IA al servizio della qualità della vita

Concludendo, credo profondamente nel potenziale dell’IA come alleato del settore sanitario. Lavoro con la convinzione che il rispetto dei principi etici e normativi sia essenziale per garantire che questa tecnologia porti vantaggi concreti, senza mai compromettere i diritti dei pazienti. La strada è ancora lunga, ma con l’approccio giusto, l’IA può davvero migliorare la qualità della nostra sanità, elevando l’efficienza dei servizi, riducendo i costi e sostenendo un modello di cure più umano e inclusivo.

Per una migliore qualità della vita.

Avvocato Giovanni Paolo Sperti

Riferimenti e fonti